天津大学:受仿生复眼启发的高空间灵敏度触觉传感器

如果机械手拥有人手一样灵敏的触觉系统,那么机械手将义肢、精细操作以及电子皮肤方面有更重要应用。但是,人的指尖触觉感受器的密度非常高,达到140个/cm2,而现有触觉传感器的密度很低。为了提高三维触觉传感器的密度,天津大学精密仪器与光电子工程学院的宋乐、朱欢、郑叶龙、赵美蓉、房丰洲,以及马来亚大学的池德阁等人受到昆虫复眼启发,研制了一种基于仿生复眼的高密度阵列曲面三维触觉传感器,其密度可达42个/cm2。该触觉传感器可以检测法向力和剪切力,该传感器将为手术机器人的力测量提供技术依据。

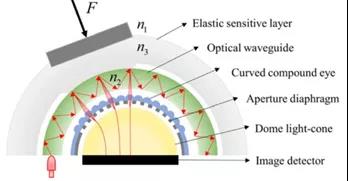

图1 仿生复眼

为了解决上述问题,本文在仿生复眼的启发下,提出了一种基于光能分布法的复眼阵列式曲面光波导触觉传感器,该系统空间分辨力高、畸变小。采用曲面复眼能够保证各个方位角的接触力信息被均匀接收,采用光锥可以将曲面图像无损转换为平面图像。触觉传感器主要包括曲面弹性敏感层,复眼阵列、光纤光锥、图像传感器以及光纤光源。弹性敏感层将三维触觉力转换为光能信息,接触产生的泄露光通过复眼、光纤光锥,最后在图像传感器上成像。根据图像传感器上的光能分布得到三维触觉力的作用方向和大小,利用光阑可以减少相邻子眼之间的耦合误差。该触觉传感器中的弹性敏感层和曲面复眼以及光纤光锥同球心,有利于触觉传感器的集成化。

当外界载荷施加在弹性敏感层上,弹性敏感层产生变形后与光波导外侧产生接触,由于接触区域不满足全内反射条件,在光波导的内侧会产生泄露光,泄露光经过复眼、光阑,最后用CCD接收。因为弹性敏感层的材料是硅胶,所以本文提出的三维触觉力测量系统具有较高的灵活性,可通过更换不同硬度的弹性敏感层来适应不同的力值测量范围,所采用的弹性敏感层的硬度为邵氏A40,以及将图像的灰度值作为法向力测量的特征参量,图像的形心位移作为剪切力测量的特征参量。

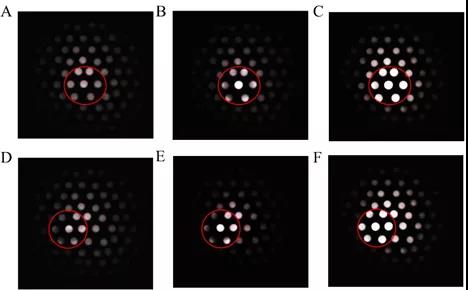

图2 法向力和剪切力实验

对弹性敏感层不同位置处进行法向力实验,对标定实验曲线进行三次多项式拟合,可以得到弹性敏感层不同位置处的曲线的拟合系数分别是0.9999,0.9999,0.9999,0.9992,0.9997,这也说明了弹性敏感层具有各向同性。在弹性敏感层的不同位置进行剪切力实验,其剪切力角度范围为[-10°10°]。以顶点处的剪切力实验为例,对标定曲线进行指数型拟合,剪切力的角度分别为-5°、5°时曲线的拟合系数均为1,角度为10°、10°时曲线的拟合系数均为0.9999。这也就说明选用图像灰度值和形心位移作为特征参量具有合理性和有效性。

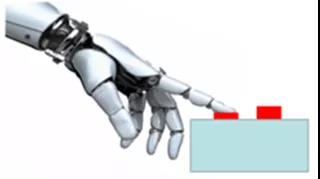

为了演示触觉传感器,以普通按钮开关为实验样品。触觉感应装置位于按钮开关的上侧,触觉感应装置逐渐按下,然后抬起,同时测量其力值。当压缩位移为0.5、0.8和1.0mm时,记录力值。力值为0.5,0.8,和1mm分别为1.23890±000286、1.6494±0.000981和2.0958±0.000168N。

图3 机械手按开关力值测量

这种新型仿生复眼高空间灵敏度触觉传感器,对于需要力值测量的小型机器人是很有用的,这也为义肢设计提供了一种新的方法。这一研究成果发表在国际期刊光学快报上:Le Song,Huan Zhu,Yelong Zheng*,Meirong Zhao,Clarence Augustine TH Tee,and Fengzhou Fang, “Bionic Compound Eye-Inspired High Spatial and Sensitive Tactile Sensor,”IEEE TRANSACTIONS ON INSTRUMENTATION AND MEASUREMENT,70,7501708(2021).本文第一作者为天津大学宋乐副教授,通讯作者为天津大学郑叶龙副教授。该研究得到国家自然科学基金(52075384、51805367),天津市自然科学基金(18JCQNJC04800)的资助。

本网站转载的文章版权归原文作者所有,如有侵权请联系我们删除。